Anthropic har sagsøgt den amerikanske regering efter, at Pentagon erklærede virksomheden som en “supply chain risk” – en beslutning, der kan ændre, hvordan udbydere af kunstig intelligens arbejder sammen med militæret. Sagsanlægget udfordrer beslutningen og rejser spørgsmål om, hvordan forsvarsleverandører vælger AI-systemer.

Markedet følger nu nøje, om konflikten kan sprede sig til selskaber forbundet med militær AI-infrastruktur, herunder softwarefirmaer som Palantir Technologies og forsvarsleverandører som Lockheed Martin.

Pentagon-mærkat udløser juridisk strid

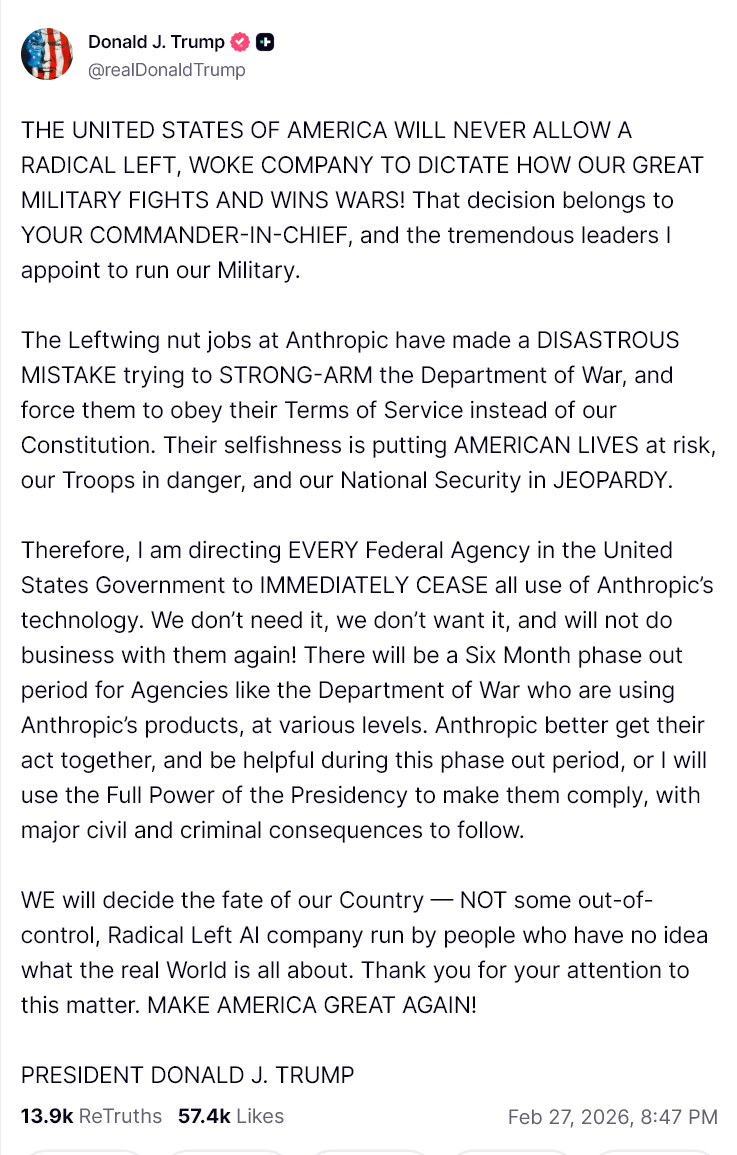

Konflikten begyndte tidligere på måneden, da det amerikanske forsvarsministerium officielt klassificerede Anthropic som supply chain risk.

Betegnelsen forhindrer effektivt forsvarsleverandører i at anvende Anthropics AI-systemer i visse militære programmer.

Pentagon-repræsentanter mente, at tiltaget beskytter nationens sikkerhed og sikrer, at AI-værktøjer brugt i forsvarssystemer lever op til strenge krav i forsyningskæden.

Beslutningen fik straks betydning for leverandører, der integrerer kommercielle AI-modeller i militær software og analyseværktøjer.

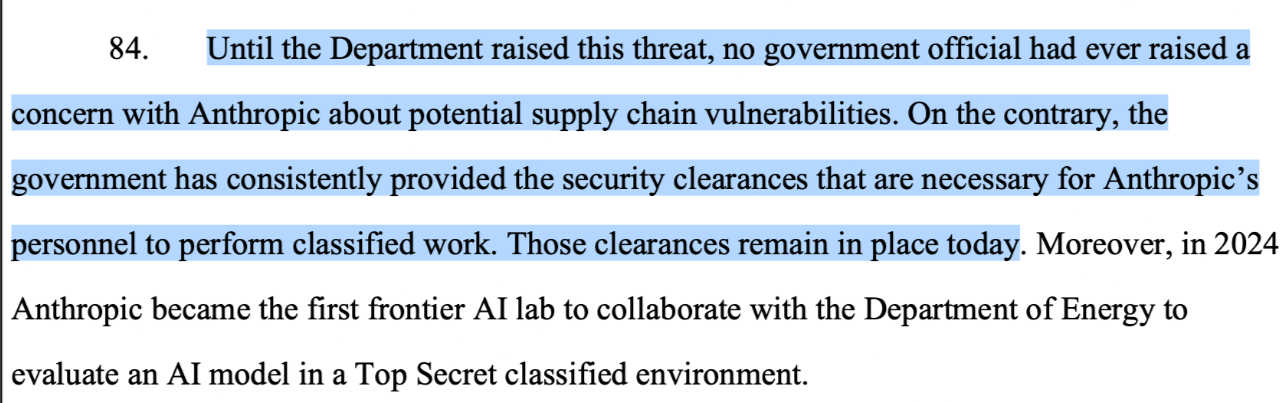

Anthropic afviste kraftigt klassificeringen. Selskabet mener, at beslutningen mangler gennemsigtighed og urimeligt kan udelukke en betydende AI-udbyder fra offentlige opgaver.

I mandags indleverede Anthropic en retssag for at udfordre regeringens beslutning.

Ifølge dokumenter fra sagen argumenterer virksomheden for, at Pentagon handlede uden tydelig begrundelse, og at mærkatet skader selskabets mulighed for at konkurrere om offentlige kontrakter.

Retssagen beder domstolen om at blokere klassificeringen og pålægge myndighederne at begrunde sikkerhedshensynene bag beslutningen.

Risici for amerikanske forsvarsteknologipartnere

Den juridiske konflikt kan skabe usikkerhed for firmaer, der er afhængige af eksterne AI-modeller i militær software.

Ét af de mest omtalte navne er Palantir Technologies, som udvikler analysesystemer, der bruges af både det amerikanske militær og efterretningsvæsnet.

Hvis Anthropics modeller bliver begrænset i forsvarsprojekter, kan Palantir og lignende leverandører blive nødt til at skifte til andre AI-udbydere.

Sådanne overgange kan forsinke implementering og kræve tekniske ændringer. Men de fleste analytikere forventer, at softwareleverandører blot skifter model i stedet for at miste offentlige kontrakter.

Store forsvarsproducenter løber en mindre risiko.

Lockheed Martin, den største amerikanske forsvarsleverandør, udtalte, at selskabet ikke er afhængig af én enkelt AI-udbyder. Virksomheden påpegede, at Pentagons beslutning formentlig får begrænset betydning for deres projekter.

Det afspejler en bredere tendens i militær teknologi: Store leverandører integrerer oftest flere samarbejdspartnere for at undgå afhængighed af én softwareudvikler.

Mulighed for konkurrerende udbydere af kunstig intelligens

Selvom retssagen skaber usikkerhed for Anthropic, kan den gavne konkurrerende AI-selskaber.

Hvis Pentagon fastholder restriktionerne, kan forsvarsleverandører rette blikket mod alternative modeller som OpenAI eller cloud-platforme forbundet med Microsoft og Amazon.

Disse udbydere leverer allerede infrastruktur og AI-tjenester til myndighederne. Et skift i indkøb kan udvide deres rolle i militær AI.

Men det endelige udfald afhænger nu af domstolene. Hvis Anthropic vinder sagen, kan Pentagon blive tvunget til at ændre eller begrænse supply-chain-mærkatet.

For investorer og forsvarsentreprenører understreger konflikten et større problem.

Efterhånden som kunstig intelligens bliver en vigtig del af militære systemer, kan regeringens evne til at godkende eller begrænse AI-leverandører få indflydelse på både teknologisektoren og forsvarsindustriens forsyningskæder.