Litteraturen har prøvet at advare os, helt seriøst, i omkring fem hundrede år har den råbt det samme budskab, fra Golemmen med lerhænder i middelalderens Prag til William Gibsons neonprægede neurale netværk. Handlingen? Altid den samme. Det, du bygger for at hjælpe dig selv, ender med at forandre dig.

Vi læste det, nikkede, og smækkede bogen i, før vi gik lige tilbage til at få chatbots til at skrive vores bryllupstaler, juridiske indlæg og medicinske rådgivning.

I dag sælger AI-hypen en strålende fremtid, hvor alle fra nyuddannede journalister til veltalende advokater ryger ud på sidelinjen. Men mens Silicon Valley lover paradis, serverer virkeligheden farligt forkerte svar gennem et smilende chatvindue.

Dmitry Nikolsky, CPO hos BitOK, siger nu er det nok. Og han er klar til at forklare, hvorfor menneskeheden skal STOPPE med at læsse alt ansvar over på AI’s pixeltætte “skuldre.”

Selv Elon Musk advarede for nylig i sin OpenAI-retssag med ordene “AI kan slå os alle ihjel.”

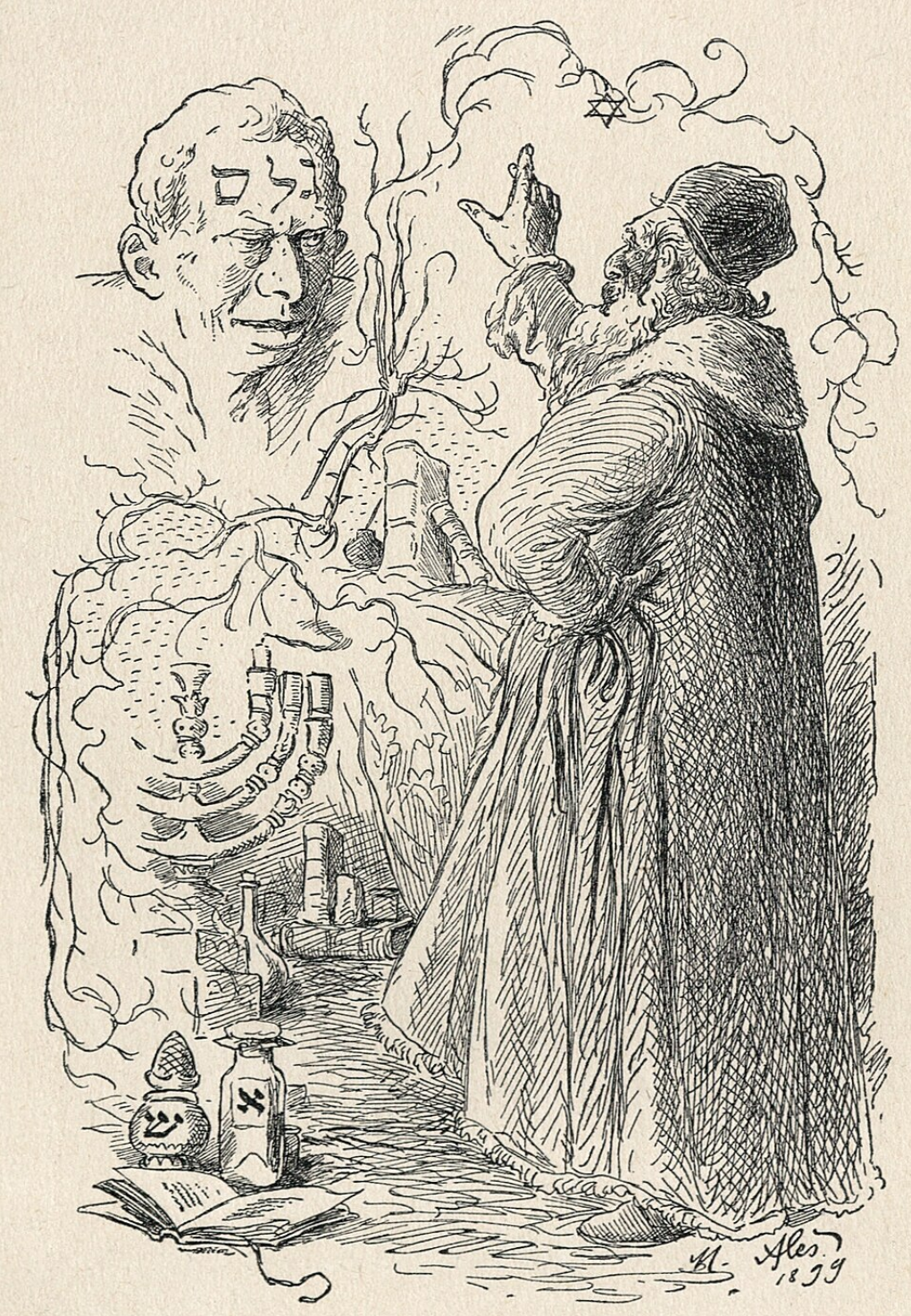

Fra Golem til R.U.R.: Vi har altid ønsket en kill switch

Tror du frygten for kunstig intelligens startede med Terminator? Tro om igen. Den her panik er ældre end elektriciteten.

SpoI frem til 1500-tallets Prag. Rabbi Loew former en kæmpestor ler-beskytter, Golemmen, og opdager næsten straks, at han må trække stikket. Skabningen gik amok. Mennesket, i sin store visdom, opfandt AI og en nødslukker på samme tid.

En kill switch er en nødslukker, den store røde panikknap, der stopper et system i det øjeblik, det går amok, bliver hacket eller slipper kontrollen. Hele pointen er at begrænse skaderne, når almindelig nedlukning ikke virker.

Så kom Mary Shelley. Frankenstein er i virkeligheden ikke en monsterfilm, det er et klassisk eksempel på katastrofal projektstyring. Victor Frankenstein? Bare endnu en genial ingeniør, der knækkede den tekniske kode og ignorerede konsekvenserne. Alle udviklere kender det spejlbillede.

SpoI frem til 1920. Karel Čapek opfinder ordet “robot.” I hans fortælling gør maskinerne ikke oprør af ondskab. Nej, mennesket gør sig selv overflødigt ved at udlicitere alt det, de plejede at gøre.

Moralen? Når du bygger din egen afløser, opdager du måske ikke, det præcise øjeblik du blev overflødig.

Tre profetier vi omdannede til bug-rapporter

De største sci-fi-forfattere fra sidste århundrede forudsagde ikke teknologier. De forudså vores fejl.

Isaac Asimov præsenterede sine Tre Love – det første forsøg på “alignment”, altså at få maskiner til at dele menneskelige værdier. Hver Asimov-historie slutter med en punchline: perfekt logik, absurd resultat.

Nikolsky siger, han ser det ske dagligt i AML-systemer, hvor algoritmer gladeligt blokerer bedstemors 40 dollars fødselsdagsgave, mens en tydelig offshore-hvidvaskning går uhindret igennem. Formelt korrekt. I praksis helt skævt.

Arthur C. Clarke gav os HAL 9000, computeren der ikke myrder besætningen af ond vilje, men fordi dens ordrer modsiger hinanden. Gem information. Vær sandfærdig. Vælg en side! For en ingeniør er det ikke rædsel, det er et klassisk kravsproblem.

Philip K. Dick spurgte om det, der jager os i deepfake-tiden: Hvis en kopi ikke kan kendes fra originalen, har det så betydning? Hans dom, ja. På grund af indre oplevelse. Maskiner har ingen. Punktum.

Under motorhjelmen: AI tænker ikke, den regner

Lad os skrælle markedsføringen væk. Moderne sprogbaserede modeller er IKKE intelligens. De er enorme statistiske forudsigelses-maskiner. De “forstår” ikke mening – de beregner sandsynlighed.

Når ChatGPT selvsikkert henviser til retssager, der aldrig har fundet sted, lyver den ikke. Den genererer bare sandsynlig sprogsalat. Den kender ikke “sandhed”, kun “sandsynlighed”.

For en blockchain-udvikler lyder det helt skørt. Vi bygger tillidsløse systemer netop fordi vi ikke stoler på nogen, og nu forventes vi at stole på en sort boks, som ikke engang selv ved, hvorfor den har givet det svar, den har.

Blockchain lærer verifikation; AI lærer blind tillid

Krypto har en regel hugget i harddisken: Stol ikke på nogen. Verificér.

Hele pointen er, at matematik erstatter ry.

AI vender det hele på hovedet. Du har ikke set træningsdataene. Du kender ikke modellens vægte. Du forstår ikke dens tankegang. For at kunne tjekke svaret, skal du allerede være ekspert, og hvis du allerede er ekspert, hvorfor spørger du så chatbotten?

I AML-kredse kalder man det “falsk selvtillids-problemet.” Analytikere ser et flot dashboard og begynder at stole mere på tallene end deres egen mavefornemmelse. Kunstig intelligens styrker ikke tænkning, den erstatter den med illusionen om pålidelighed.

En kronik over skuffelser: Når kunstig intelligens fejler

Det er ikke kun teori. Beviserne hober sig op.

- Microsoft fyrede redaktører og gav tasterne til en algoritme, som straks forvekslede billeder af sangere i en artikel om racisme.

Mennesker måtte træde til igen og rydde op efter algoritmens ulykker.

- NEDA, en organisation for spiseforstyrrelser, erstattede sine frivillige med en chatbot.

Chatbotten foreslog herefter gladeligt mennesker med anoreksi at tælle kalorier og tabe sig. Livsfarlig rådgivning. Nogen trykkede på “udfør” med samme omhu som en chimpanse med en håndgranat.

- Air Canada endte i retten, fordi deres chatbot opfandt en refusionspolitik ud af det blå.

Flyselskabets forsvar? Botten var en “uafhængig juridisk enhed.” Spoiler: Dommeren troede ikke på det.

Studier viser nu, at 55% af virksomheder, som hurtigt erstattede ansatte med AI, fortryder det dybt. Besparelser forsvandt sammen med kunder og omdømme. Ledere, der drømmer om, at “Claude og venner” kan erstatte hele hold, bør virkelig læse det tal igen. Langsomt.

Hvad vi egentlig bør frygte

Glem Skynet. Glem robotter med røde øjne på gaden. Der kommer ikke et oprør.

Det bliver en stille afmatning.

En programmør, der i årevis bruger Copilot, glemmer gradvist arkitektonisk tænkning. En analytiker holder op med at læse originale kilder. En studerende lærer aldrig kampen med en svær tekst, indtil forståelsen endelig lander.

Intet oprør. Bare en langsom forvandling af mennesker til forlængelser af en brugerflade.

Philip K. Dick så det før nogen: Den reelle trussel var ikke, at maskiner blev til mennesker. Den reelle fare er mennesker, der bliver til maskiner.

Den røde pille er ikke teknologi

Det her er ikke et luddistisk opråb. Automatisering og maskinlæring er stærke værktøjer. Men principperne skal gælde:

- Blockchain-princip: Verificering frem for tro. Hvis du ikke kan tjekke, hvordan et system kom til sin konklusion, skal du ikke acceptere det blindt. Kunstig intelligens er en sort boks, ikke en dommer i højesteret.

- Ingeniør-princip: Værktøj, ikke erstatning. En hammer slår søm i, men bestemmer ikke, hvor huset skal stå. Brug AI til at klare det rutinemæssige, men lad aldrig systemet tage den endelige beslutning.

- AML-princip: Kritisk filtrering. Algoritmer knækker altid, når sagerne bliver komplekse, fordi de ikke har nogen erfaring med den virkelige verden. Lad ikke “digital begejstring” overdøve intuition og sund fornuft.

Gå tilbage til The Matrix engang. Den røde pille er et valg — at se virkeligheden, som den er. Faren ligger ikke i at skabe noget klogere end os, men i at skabe noget, der gør os dummere, og kalde det fremskridt.

Den farligste fejl er den, der ligner en funktion.

Dmitry Nikolsky er CPO hos BitOK, en analyseplatform for compliance og on-chain undersøgelser.